- 资源介绍

- 更新记录

试看链接 https://pan.baidu.com/s/1PowD5062D4xn_8vQu8P75w?pwd=ci9u

相关推荐

C大-MCP+GraphRAG+LLM的智能体agent全栈开发实战

LLM应用全流程开发 全新技术+多案例实战+私有化部署(已完结)

LLM大模型智能引擎实战–SpringAI+RAG+MCP+实时搜索(已完结)

课程介绍

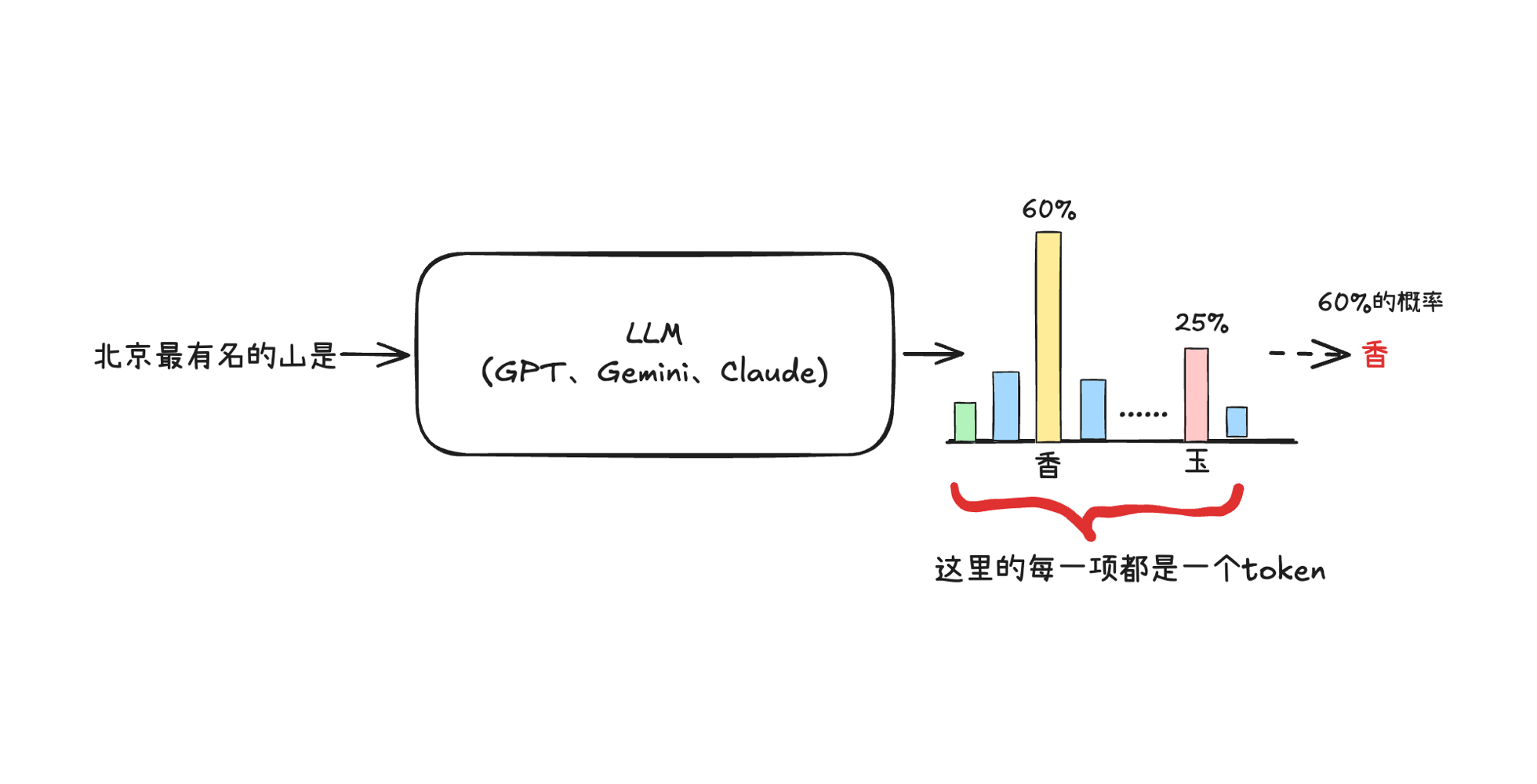

LLM大模型开发工程师已经成为各大公司争抢的战略性高薪人才,如果你想尽早入行,这门课程就是专为你设计的高效学习路径。课程从模型构建起步,手把手教你完成指令微调、高效数据集搭建、训练流水线搭建及模型知识蒸馏等关键任务。只要跟着教学安排,稳扎稳打,就能顺利训练出私有化、可压缩、可上线的轻量大模型。通过本课程的学习,助力你先人一步具备私有化模型开发实战能力,跃升成为高薪技术人才。

课程目录

第1章 课程导学

-

1-1 LLM开发工程师入门实战-课程导学

第2章 初识大语言模型

-

2-1 开启你的AI智慧之旅-本章导学

-

2-2 开启你的AI智慧之旅-初识大语言模型

-

2-3 开启你的AI智慧之旅-大语言模型擅长的事儿

-

2-4 开启你的AI智慧之旅-大语言模型的诞生过程

-

2-5 开启你的AI智慧之旅-从0到1构建大语言模型的意义

-

2-6 开启你的AI智慧之旅-大语言模型的局限性与挑战

-

2-7 开启你的AI智慧之旅-大语言模型的未来展望

第3章 开发环境的搭建

-

3-1 开发环境搭建-导学

-

3-2 开发环境搭建-MiniConda安装与使用

-

3-3 开发环境搭建-使用pip命令安装依赖包

-

3-4 开发环境搭建-VsCode的配置

-

3-5 开发环境搭建-手攒超级计算机-硬件(自己够买硬件者选看)

-

3-6 开发环境搭建-Nvidia与CUDA关系及Linux下Nvidia驱动的安装(Linux下搭建环境者选看)

-

3-7 开发环境搭建-Windows下Nvidia驱动的安装(Windows下搭建环境者选看)

-

3-8 开发环境搭建-使用Docker搭建环境一(需要Docker搭建环境者选看)

-

3-9 打开发环境搭建-使用Docker搭建环境二(需要Docker搭建环境者选看)

-

3-10 开发环境搭建-申请阿里云的免费GPU和CPU资源(想使用阿里云服务者选看)

-

3-11 开发环境搭建-申请Kaggle的免费GPU和CPU资源(想使用Kaggle且有科学上网工具者选看)

-

3-12 开发环境搭建-申请Google的免费GPU和CPU资源(想使用Google云且有科学上网工具者选看)

第4章 牛刀小试:使用HuggingFace训练GPT-2

-

4-1 使用HuggingFace训练GPT2-导学

-

4-2 HuggingFace简介

-

4-3 使用HuggingFace训练GPT2-基本步骤

-

4-4 使用HuggingFace训练GPT2-全流程体验(后面会详解)

-

4-5 使用HuggingFace训练GPT2-详解group_text的实现

-

4-6 使用HuggingFace训练GPT2-详解generate_text的实现

第5章 提高学习效率:驾驭LLM的对话艺术与工具 (初学AI者选看)

-

5-1 提高工作效率-导学

-

5-2 提高工作效率工具-通义灵码与小浣熊

-

5-3 提高工作效率工具-Copilot

-

5-4 大语言模型助手-Kimi

-

5-5 大语言模型助手-NewBing

-

5-6 大语言模型助手-Gemini

-

5-7 大语言模型助手-Poe

-

5-8 大语言模型提示词(一)

-

5-9 大语言模型提示词(二)

-

5-10 大语言模型提示词(三)

-

5-11 大语言模型提示词(四)

-

5-12 大语言模型提示词(五)

-

5-13 本章小结

第6章 必知必会的基础知识:Python语言基础 (没有Pytorh基础者选看)

-

6-1 Python语言基础知识-导学

-

6-2 Python语言基础知识-变量的定义与使用

-

6-3 Python语言基础知识-逻辑判断与优先级

-

6-4 Python语言基础知识-循环

-

6-5 Python语言基础知识-函数的定义与使用

-

6-6 Python语言基础知识-类与对象

-

6-7 Python语言基础知识-四种复合类型

-

6-8 Python语言基础知识-可变变量与不可变变量

-

6-9 Python语言基础知识-特有技术切片

-

6-10 Python语言基础知识-其它特有技术

-

6-11 Pythony语言基础知识-NumPy库的使用

-

6-12 Python语言基础知识-MatPlotLib库的使用

-

6-13 Python语言基础知识-本章小结

第7章 深度学习核心入门:洞悉AI的学习之道 (无深度学习经验者选看)

-

7-1 深度学习核心入门-导学

-

7-2 深度学习核心入门-人工智能、机器学习与深度学习的关系

-

7-3 深度学习核心入门-神经元与神经网络

-

7-4 深度学习核心入门-监督学习与无监督学习

-

7-5 深度学习核心入门-数据集的划分

-

7-6 深度学习核心入门-过拟合、欠拟合与代价函数

-

7-7 深度学习核心入门-代价函数的意义

-

7-8 深度学习核心入门-梯度下降

-

7-9 深度学习核心入门-线性回归代价函数的导数

-

7-10 深度学习核心入门-学习率

-

7-11 深度学习核心入门-逻辑回归

-

7-12 深度学习核心入门-sigmoid激活函数

-

7-13 深度学习必备的基础知识-逻辑回归的代价函数

-

7-14 深度学习必备的基础知识-逻辑回归的梯度下降

-

7-15 深度学习必备的基础知识-逻辑回归代价函数关于w和b偏导后的公式证明

-

7-16 深度学习必备的基础知识-深度神经网络与前向传播

-

7-17 深度学习必备的基础知识-多种激活函数

-

7-18 深度学习必备的基础知识-反向传播与计算图

-

7-19 深度学习必备的基础知识-前向传播与反向传播的完整过程

第8章 掌握“炼丹术”:优化深度学习训练参数 (无深度学习经验者选看)

-

8-1 优化深度学习训练参数-导学

-

8-2 深度神经网络参数优化-向量化与矩阵化

-

8-3 深度神经网络参数优化-L2正则化

-

8-4 深度神经网络参数优化-Dropout

-

8-5 深度神经网络参数优化-数据归一化处理

-

8-6 深度神经网络参数优化-初始化权重参数

-

8-7 深度神经网络参数优化-全批量梯度下降

-

8-8 深度神经网络参数优化-随机梯度下降与小批量梯度下降

-

8-9 深度神经网络参数优化-梯度参数调优

-

8-10 深度神经网络参数优化-BatchNormalization

第9章 【实战】手写字识别:第一个AI模型诞生记 (无深度学习经验者选看)

-

9-1 [实战]手写字识别-导学

-

9-2 [实战]手写字识别- Pytorch的一点历史

-

9-3 [实战]手写字识别-Pytorch加载数据集

-

9-4 [实战]手写字识别-Pytorch导入训练数据和测试数据

-

9-5 [实战]手写字识别-构建手写字神经网络

-

9-6 [实战]手写字识别-Pytorch实现训练逻辑代码

-

9-7 [实战]手写字识别-Pytorch实现评估神经逻辑代码

-

9-8 [实战]手写字识别-Pytorch训练和评估神经网络

-

9-9 [实战]手写字识别-模型的保存部署与使用

-

9-10 [实战]手写字识别-训练参数调优

第10章 【实战】数据爬取与清洗:为大模型“备粮草”

-

10-1 [实战]数据与爬虫-导学

-

10-2 [实战]数据与爬虫-大语言模型的食谱

-

10-3 [实战]数据与爬虫-实现网络爬虫(一)

-

10-4 [实战]数据与爬虫-实现网络爬虫(二)

-

10-5 [实战]数据与爬虫-实现网络爬虫(三)

-

10-6 [实战]数据与爬虫-实现网络爬虫(四)

-

10-7 [实战]数据与爬虫-清洗数据(一)

-

10-8 [实战]数据与爬虫-清洗数据(二)

-

10-9 [实战]数据与爬虫-清洗数据(三)

-

10-10 [实战]数据与爬虫-小结

第11章 让机器读懂文本:文本与分词艺术

-

11-1 文本与分词艺术-导学

-

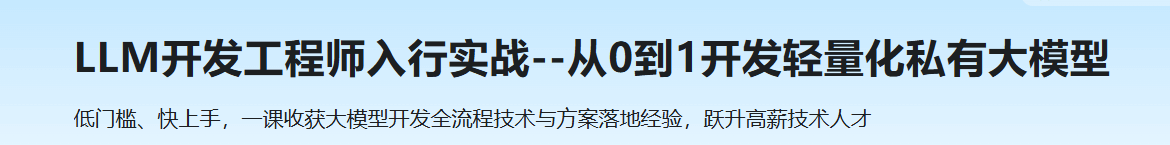

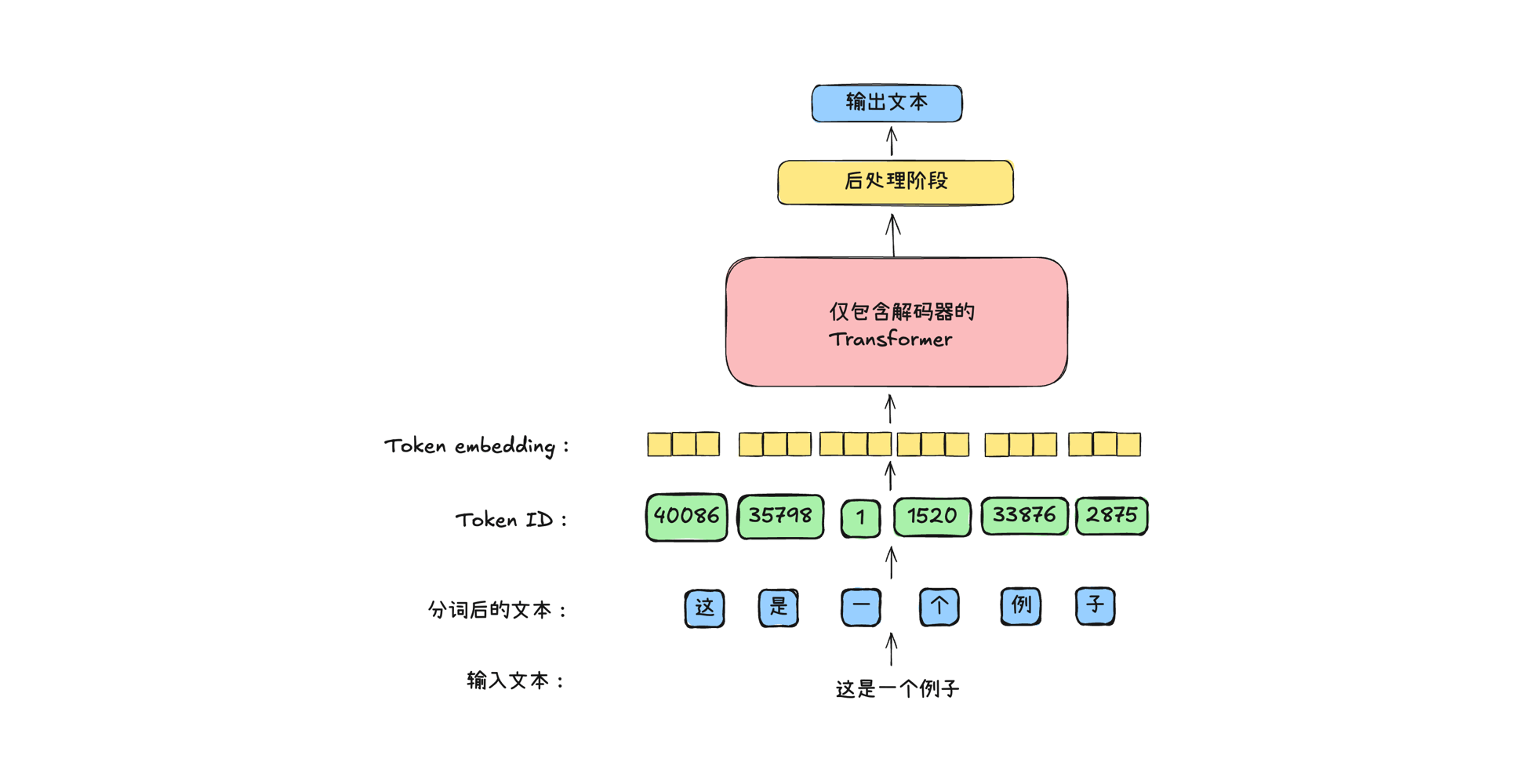

11-2 文本与分词艺术-文本向量化的完整过程

-

11-3 文本与分词艺术-文本分词

-

11-4 文本与分词艺术-构造文本字典

-

11-5 文本与分词艺术-实现Tokenizer类

-

11-6 文本与分词艺术-文本转TokenID

-

11-7 文本与分词艺术-TokenID转文本

-

11-8 文本与分词艺术-基于统计的分词技术

-

11-9 文本与分词艺术-GPT-tiktoken分词器

-

11-10 文本与分词艺术-文本向量化(Embedding)

-

11-11 文本与分词艺术-实战TokenID转向量

-

11-12 文本与分词艺术-本章小结

第12章 画龙点睛:注意力机制的奥秘

-

12-1 注意力机制-导学

-

12-2 注意力机制-什么是注意力机制

-

12-3 注意力机制-三个关键元素QKV

-

12-4 注意力机制-注意力机制与自注意力机制的区别

-

12-5 注意力机制-注意力分数

-

12-6 注意力机制-缩放因子

-

12-7 注意力机制-实现注意力机制的具体过程

-

12-8 注意力机制-注意力机制的矩阵化

-

12-9 注意力机制-代码实现

第13章 石破天惊:Transformer架构的革命

-

13-1 Transformer架构-Transformer整体结构

-

13-2 Transformer架构-词嵌入(Embedding)

-

13-3 Transformer架构-位置编码

-

13-4 Transformer架构-多头注意力机制

-

13-5 Transformer架构-编解码器中的残差网络与层归一化

-

13-6 Transformer架构-掩码注意力机制

-

13-7 Transformer架构-解码器

第14章 麻雀虽小,五脏俱全:实现‘迷你’版大语言模型

-

14-1 迷你GPT-导学

-

14-2 迷你GPT-GPT架构

-

14-3 迷你GPT-GPT中的位置编码

-

14-4 迷你GPT-实现GPT骨架(一)

-

14-5 实现GPT-迷你GPT骨架(二)

-

14-6 迷你GPT-实现自注意力机制(一)

-

14-7 迷你GPT-实现自注意力机制(二)

-

14-8 迷你GPT-实现掩码注意力机制(一)

-

14-9 迷你GPT-实现掩码注意力机制(二)

-

14-10 迷你GPT-实现多头注意力机制

-

14-11 迷你GPT-实现层归一化

-

14-12 迷你GPT-实现GELU激活函数与前馈网络

-

14-13 迷你GPT-残差与TransformerBlock

-

14-14 迷你GPT-测试GPTModel

-

14-15 迷你GPT-生成文本(一)

-

14-16 迷你GPT-生成文本(二)

-

14-17 迷你GPT-生成文本(三)

-

14-18 迷你GPT-文本评估

-

14-19 迷你GPT-交叉熵损失函数

-

14-20 迷你GPT-创建并加载数据集(一)

-

14-21 迷你GPT-创建并加载数据集(二)

-

14-22 迷你GPT-实现模型

-

14-23 -迷你GPT-评估模型

-

14-24 迷你GPT-开始训练

-

14-25 迷你GPT-优化输出(一)

-

14-26 迷你GPT-优化输出(二)

-

14-27 迷你GPT-保存并加载训练好的模型

第15章 模型微调与文本分类:让通用模型变身专家

-

15-1 微调模型-导学

-

15-2 微调模型-获得高质量的训练数据

-

15-3 微调模型-构造Dataset

-

15-4 微调模型-创建DataLoader(一)

-

15-5 微调模型-创建Dataloader(二)

-

15-6 微调模型-加载GPT2预训练模型(一)

-

15-7 微调模型-加载GPT2预训练模型(二)

-

15-8 微调模型-指令微调(一)

-

15-9 微调模型-指令微调(二)

-

15-10 微调模型-绘制损失趋势图

-

15-11 微调模型-为模型评分(一)

-

15-12 微调模型-为模型评分(二)

-

15-13 微调模型-LoRA(一)

-

15-14 微调模型-LoRA(二)

第16章 知识蒸馏:智慧的浓缩与传承

-

16-1 知识蒸馏-导学

-

16-2 知识蒸馏-获取思维链蒸馏数据(一)

-

16-3 知识蒸馏-获取思维链蒸馏数据(二)

-

16-4 知识蒸馏-清洗错误数据

-

16-5 知识蒸馏-黑盒思维链蒸馏

-

16-6 知识蒸馏-白盒知识蒸馏

第17章 减少模型幻觉:为LLM插上RAG的“记忆”之翼

-

17-1 减少模型幻觉-RAG技术导学

-

17-2 减少模型幻觉-RAG工作原理

-

17-3 减少模型幻觉-RAG实现(一)

-

17-4 减少模型幻觉-RAG实现(二)

第18章 Agent与MCP:从语言到行动的终极进化

-

18-1 Agent与MCP-导学

-

18-2 Agent与MCP-Agent工作原理

-

18-3 Agent与MCP-Agent常见模式

-

18-4 Agent与MCP-Agent调用工具(一)

-

18-5 Agent与MCP-Agent调用工具(二)

-

18-6 Agent与MCP-Agent调用工具(三)

-

18-7 Agent与MCP-记忆与上下文工程

-

18-8 Agent与MCP-实现一个Agent

第19章 课程总结

-

19-1 课程总结

常见问题FAQ

- 视频课程没更新怎么办?

- 课程免费更新,持续更新

- 购买后怎么如何下载资源?

- 有些资源没更新完结怎么办?

- 有问题不懂想咨询怎么办?

- 2025-03-11Hi,初次和大家见面了,请多关照!

最后编辑:2026-02-05

最后编辑:2026-02-05